导语:算力、内存及生态,端侧天生式AI落地的要害。

于感触感染了ChatGPT及文生视频模子Sora接连带来震撼以后,所有人城市好奇,天生式AI与平凡人的糊口有甚么瓜葛?

手机厂商已经经展示了天生式AI带来的全新体验,好比小米14系列的图象扩充,OPPO Find X7 Ultra的一键AI路人消弭,荣耀Magic6的聪明成片及聪明创立日程。

假如说云真个天生式AI展示了AI的强盛,那端侧AI的普和就是引发天生式AI立异的动力。

想要于端侧普和天生式AI,需要先解决算力、内存及生态三浩劫题。

异构计较及NPU解决算力瓶颈

天生式AI模子参数目年夜,算力是一个焦点限定因素。

但年夜算力往往象征着高能耗,对于在利用电池供电的AI手机及AI PC,想要统筹高机能及低功耗,异构架构的价值十分较着。

异构架构,就是一个处置惩罚器傍边包罗多种差别类型的处置惩罚单位。

手机SoC就是典型的异构架构,包罗擅长挨次节制,合用在需要低时延的运用场景的CPU;擅长高精度格局图象及视频并行处置惩罚的GPU;还有有擅长标量、向量及张量数学运算,可用在焦点AI事情负载的NPU。

异构计较的上风于在,可以按照运用的类型挪用适合的处置惩罚器以到达最好的能耗比,好比用GPU来完成重负荷游戏,用CPU履行多网页阅读,用NPU晋升AI体验。

对于在天生式AI,异构计较的上风越发较着,由于天生式AI有多种用例,好比只需要短暂运行的按需型用例;需要永劫间运行的连续型用例,如AI视频处置惩罚;以和始终开启的泛于型用例,如PC需要连续监测用户的装备利用环境,差别的用例对于处置惩罚器的需求差别。

以于高通骁龙平台上实现虚拟AI助手与用户语音互动交流来注释异构计较的主要性。

用在给虚拟AI助手下达指令,需要经由过程主动语音辨认(ASR)模子转化为文本,这一步重要于高通传感器中枢运行。

然后需要经由过程Llama 2或者百川年夜语言模子天生文本答复,这一模子于Hexagon NPU上运行

接下来要经由过程开源TTS(Text to Speech)模子将文本转为语音,这一历程需要CPU。

输出语音的同时,需要利用交融变形动画(Blendshape)技能让语音与虚拟化身的嘴型匹配,实现音话同步。今后,经由过程空幻引擎MetaHuman举行虚拟化身衬着,衬着事情于Adreno GPU上完成。

终极经由过程协同利用高通AI引擎上所有的多样化处置惩罚模块,实现精彩的交互体验。

高通自2015年推出第一代AI引擎,就采用的异构计较的架构,包罗Kryo CPU、Adreno GPU、Hexagon DSP,这是高通连结于端侧AI范畴领先的要害。

异构计较对于在天生式AI的普和很是主要,此中的NPU又是要害。

好比于连续型用例中,需要以低功耗实现连续不变的岑岭值机能,NPU可以阐扬其最年夜上风。于基在LLM及年夜视觉模子(LVM)的差别用例,例如Stable Diffusion或者其他扩散模子中,NPU的每一瓦特征能体现十分精彩。

“高通NPU的差异化上风于在体系级解决方案、定制设计及快速立异。经由过程定制设计NPU并节制指令集架构(ISA),高通可以或许快速举行设计演进及扩大,以解决瓶颈问题并优化机能。”高通技能公司产物治理高级副总裁 Ziad Asghar暗示。

雷峰网(公家号:雷峰网)相识到,高通对于NPU的研究也是追随需求的变化而演进,以Hexagon DSP为基础,进化为Hexagon NPU。

“从DSP架构入手打造NPU是准确的选择,可以改善可编程性,并可以或许慎密节制用在AI处置惩罚的标量、向量及张量运算。高通优化标量、向量及张量加快的的设计方案联合当地同享年夜内存、专用供电体系及其他硬件加快,让咱们的方案独树一帜。”Ziad Asgha说。

Hexagon NPU从2015年时面向音频及语音处置惩罚的的简朴CNN,到2016-2022年之间面向AI影像及视频处置惩罚,以实现加强的影像能力的Transformer、LSTM、RNN、CNN。

2023年,高通于Hexagon NPU中增长了Transformer撑持。可以或许于终端侧运行高达100亿参数的模子,不管是首个token的天生速率还有是每一秒天生token的速度都处于业界领先程度。

测试数据显示,第三代骁龙8及三款Android以和iOS平台竞品的对于比,于MLCo妹妹on MLPerf推理的差别子项中,例如图象分类、语言理解以和超等分辩率等,第三代高通骁龙8都连结领先。

一样集成为了高通AI引擎的骁龙X Elite,于面向Windows的UL Procyon AI推理基准测试中,ResNet-50、DeeplabV3等测试中,基准测试总分别离为X86架构竞品A的3.4倍及竞品B的8.6倍。

怎样解决内存瓶颈?

限定天生式AI普和的不仅有计较能力的限定,内存限定也是年夜语言模子token天生的瓶颈,这要解决的是CPU、GPU、NPU的内存效率问题。

内存瓶颈来历在AI计较数据的读取及搬移。

例如,一个NxN矩阵及另外一个NxN矩阵相乘,需要读取2N2个值并举行2N3次运算(单个乘法及加法)。于张量加快器中,每一次内存拜候的计较操作比率为N:1,而对于在标量及向量加快器,这一比率要小患上多。

解决内存瓶颈的挑战,高通有微切片及量化等要害技能。

2022年发布的第二代骁龙8,微切片推理使用HexagonNPU的标量加快能力,将神经收集支解成多个可以或许自力履行的微切片,消弭了高达10余层的内存占用,市道上的其他AI引擎则必需要逐层举行推理。

量化技能也是解决内存挑战的要害。高通Hexagon NPU原生撑持4位整数(INT4)运算,可以或许晋升能效及内存带宽效率,同时将INT4层及神经收集的张量加快吞吐量量提高一倍。

于最新的第三代骁龙8中,Hexagon NPU微架构进级,微切片推理进一步进级,撑持更高效的天生式Al处置惩罚,并降低内存带宽占用。

此外,Hexagon张量加快器增长了自力的电源传输轨道,让需要差别标量、向量及张量处置惩罚范围的AI模子可以或许实现最高机能及效率。同享内存的带宽也增长了一倍。

还有有一个很是要害的进级,第三代骁龙8撑持业界最快的内存配置之一:4.8GHzLPDDR5x,撑持77GB/s带宽,可以或许满意天生式AI用例日趋增加的内存需求。

更高机能的内存联合进级的微切片及量化技能,能最年夜水平消弭端侧AI普和内存的瓶颈。固然,天生式AI模子也于变化。

“高通AI引擎中集成为了模子压缩等更多技能,以确保模子可以或许于DRAM上顺遂运行。”Ziad Asghar说,“于模子端,咱们看到MoE(Mixture of Experts)模子鼓起的趋向,这一类型的模子可以或许将特定部门放于内存中运行,其他的放于内存外,对于模子举行优化。”

计较及内存限定的问题以后,是更具挑战性的生态问题。

怎样降低AI开发门坎?

AI潜力的发作需要生态的繁荣,生态的繁荣需要充足多的开发者,终极这就酿成了一个AI开发门坎的问题。

对于在硬件平台的提供者来讲,可以最年夜化降低开发者的利用门坎,可以或许闪开发者用高级语言开发的步伐简朴高效地运行于AI引擎上。

高通做了很是多的事情,高通AI软件栈(Qualco妹妹 AI Stack),撑持今朝所有的主流AI框架,包括TensorFlow、PyTorch、ONNX、Keras;它还有撑持所有主流的AI runtime,包括DirectML、TFLite、ONNX Runtime、ExecuTorch,以和撑持差别的编译器、数学库等AI东西。

“咱们还有推出了Qualco妹妹 AI studio,为开发者提供开发历程中需要用到的相干东西,此中包括撑持模子量化及压缩的高通AI模子增效东西包(AIMET),可以或许让模子运行越发高效。”Ziad Asgha进一步暗示,“基在高通AI软件栈及焦点硬件IP,咱们可以或许跨高通所有差别产物线,将运用范围化扩大到差别类型的终端,从智能手机到PC、物联网终端、汽车等。”

AI生态的繁荣,还有需要多方的配合努力,高通撑持Transformer的Hexagon NPU,以和异构的高通AI引擎,已经经提供了很好的基础。

还有需要看到的是,终端侧AI处置惩罚有成本、能效、靠得住性、机能时延、个性化方面的诸多上风。相识更多终端侧天生式AI的资料可以查阅《经由过程NPU及异构计较开启终端天生式AI》白皮书。

雷峰网原创文章,未经授权禁止转载。详情见转载须知。

-js555888金沙(中国)有限公司官网

js555888金沙GDSM-ES智能零售管理系统为全球零售门店客户提供了功能齐全的数字化运营管理工具,提供显示信息编辑、信息发布、AI识别、客户分析和会员管理等功能,实现了对设备、内容、营销、运营的综合数智化管理能力,为精准运营管理赋能。

js555888金沙GDSM-ES智能零售管理系统为全球零售门店客户提供了功能齐全的数字化运营管理工具,提供显示信息编辑、信息发布、AI识别、客户分析和会员管理等功能,实现了对设备、内容、营销、运营的综合数智化管理能力,为精准运营管理赋能。 js555888金沙GDSM-C数字化信息发布管理系统主要通过控制智能媒体播放设备,主要应于在大型商场、超市、酒店大堂、饭店、影院、校园、机场、赛事等公共场所,通过大屏幕终端显示设备,发布商业、财经和娱乐信息的多媒体专业视听系统。

js555888金沙GDSM-C数字化信息发布管理系统主要通过控制智能媒体播放设备,主要应于在大型商场、超市、酒店大堂、饭店、影院、校园、机场、赛事等公共场所,通过大屏幕终端显示设备,发布商业、财经和娱乐信息的多媒体专业视听系统。 js555888金沙Remo on智能远程监管系统为帮助全球客户的设备数字化管理而研发,该系统可以对客户的智能硬件产品进⾏集中式远程控制,并提供实时监测功能,自我修复异常,客户可以更加便捷地管理和维护设备,同时提⾼设备的稳定性和可靠性,减少维护成本。

js555888金沙Remo on智能远程监管系统为帮助全球客户的设备数字化管理而研发,该系统可以对客户的智能硬件产品进⾏集中式远程控制,并提供实时监测功能,自我修复异常,客户可以更加便捷地管理和维护设备,同时提⾼设备的稳定性和可靠性,减少维护成本。 js555888金沙GAM-AI视觉识别管理系统采用专业的人脸识别算法,支持设置年龄和性别属性,不同性别的不同年龄段对应其针对性的广告节目,当终端摄像头识别到与节目相匹配的特征时,设备主动切换到其对应的精准节目

js555888金沙GAM-AI视觉识别管理系统采用专业的人脸识别算法,支持设置年龄和性别属性,不同性别的不同年龄段对应其针对性的广告节目,当终端摄像头识别到与节目相匹配的特征时,设备主动切换到其对应的精准节目 js555888金沙GDSM-IS物联网信息管理系统实现对多类型物联网硬件设备的实时监控及数据采集,并进行数据分析,实现系统端数据汇聚、公开展⽰以及预警告警的信息化管理,适用于工业生产、城市管理、能源管理和环境监测等多种应⽤场景。

js555888金沙GDSM-IS物联网信息管理系统实现对多类型物联网硬件设备的实时监控及数据采集,并进行数据分析,实现系统端数据汇聚、公开展⽰以及预警告警的信息化管理,适用于工业生产、城市管理、能源管理和环境监测等多种应⽤场景。 js555888金沙GSM边缘存储管理系统实现数据存储和业务应用的一体化集成,协助用户在边缘侧实现数据的存储、管理和应用,具备病毒防护、数据加密备份、自动清除潜在隐患等功能,同时有效降低对云端服务器和网络带宽的依赖,使用户数据存储更安全。

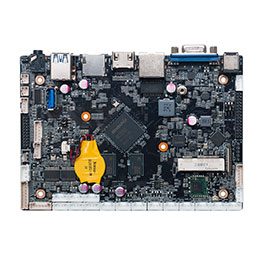

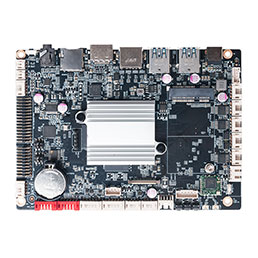

js555888金沙GSM边缘存储管理系统实现数据存储和业务应用的一体化集成,协助用户在边缘侧实现数据的存储、管理和应用,具备病毒防护、数据加密备份、自动清除潜在隐患等功能,同时有效降低对云端服务器和网络带宽的依赖,使用户数据存储更安全。 智慧教育解决方案基于物联网和人工智能技术,实现设备的精益生产管理和最优级别运行。js555888金沙的嵌入式电脑、AI边缘计算等硬软件,可广泛应用于工业自动化、智能制造和智慧工厂...

智慧教育解决方案基于物联网和人工智能技术,实现设备的精益生产管理和最优级别运行。js555888金沙的嵌入式电脑、AI边缘计算等硬软件,可广泛应用于工业自动化、智能制造和智慧工厂... 智能办公解决方案基于物联网和人工智能技术,实现设备的精益生产管理和最优级别运行。js555888金沙的嵌入式电脑、AI边缘计算等硬软件,可广泛应用于工业自动化、智能制造和智慧工厂...

智能办公解决方案基于物联网和人工智能技术,实现设备的精益生产管理和最优级别运行。js555888金沙的嵌入式电脑、AI边缘计算等硬软件,可广泛应用于工业自动化、智能制造和智慧工厂... 智能制造解决方案基于物联网和人工智能技术,实现设备的精益生产管理和最优级别运行。js555888金沙的嵌入式电脑、AI边缘计算等硬软件,可广泛应用于工业自动化、智能制造和智慧工厂...

智能制造解决方案基于物联网和人工智能技术,实现设备的精益生产管理和最优级别运行。js555888金沙的嵌入式电脑、AI边缘计算等硬软件,可广泛应用于工业自动化、智能制造和智慧工厂... 智慧零售解决方案基于物联网和人工智能技术,实现设备的精益生产管理和最优级别运行。js555888金沙的嵌入式电脑、AI边缘计算等硬软件,可广泛应用于工业自动化、智能制造和智慧工厂...

智慧零售解决方案基于物联网和人工智能技术,实现设备的精益生产管理和最优级别运行。js555888金沙的嵌入式电脑、AI边缘计算等硬软件,可广泛应用于工业自动化、智能制造和智慧工厂... 交通物流解决方案基于物联网和人工智能技术,实现设备的精益生产管理和最优级别运行。js555888金沙的嵌入式电脑、AI边缘计算等硬软件,可广泛应用于工业自动化、智能制造和智慧工厂...

交通物流解决方案基于物联网和人工智能技术,实现设备的精益生产管理和最优级别运行。js555888金沙的嵌入式电脑、AI边缘计算等硬软件,可广泛应用于工业自动化、智能制造和智慧工厂... 智慧城市解决方案基于物联网和人工智能技术,实现设备的精益生产管理和最优级别运行。js555888金沙的嵌入式电脑、AI边缘计算等硬软件,可广泛应用于工业自动化、智能制造和智慧工厂...

智慧城市解决方案基于物联网和人工智能技术,实现设备的精益生产管理和最优级别运行。js555888金沙的嵌入式电脑、AI边缘计算等硬软件,可广泛应用于工业自动化、智能制造和智慧工厂... 智慧农业解决方案基于物联网和人工智能技术,实现设备的精益生产管理和最优级别运行。js555888金沙的嵌入式电脑、AI边缘计算等硬软件,可广泛应用于工业自动化、智能制造和智慧工厂...

智慧农业解决方案基于物联网和人工智能技术,实现设备的精益生产管理和最优级别运行。js555888金沙的嵌入式电脑、AI边缘计算等硬软件,可广泛应用于工业自动化、智能制造和智慧工厂...